[9월의 AI 트렌드] 일반 GPU로 AI모델 학습이 가능해졌다!

글: SK브로드밴드 AIX R&D팀 전혜윤 매니저

안녕하세요.

9월에도 AI 관련한 새로운 소식들이 많이 전해졌는데요.

오픈AI가 기존 챗봇보다 추론 능력이 훨씬 뛰어난 ‘o1’을 공개했답니다.

‘o1’의 능력이 궁금하시다구요?

그럼 오픈AI의 ‘o1’ 관한 내용과 다른 AI 소식도 자세히 알려드릴게요!

<목차>

메타, 첫 멀티모달모델 '라마 3.2' 출시..."오픈 소스로 폐쇄형 잡을 것"

KAIST, 엔비디아 GPU 없이 AI 학습하는 프레임워크 개발

구글, 통계 데이터 응답 정확도 높인 모델 ‘데이터젬마’ 공개

👉🏻 위의 목차 중 원하시는 주제명을 클릭하시면, 해당 본문으로 바로 이동할 수 있습니다.

오픈AI, ‘추론’하는 새 AI 모델 'o1' 공개

1. Summary: 오픈AI가 새로운 챗GPT 모델인 '오픈AI o1'을 12일 출시했다. 이 모델은 기존의 GPT-4.5나 GPT-5라는 명칭 대신 'o1'이라는 새로운 브랜드명을 채택했다.

이는 기존 모델과는 다른 방식을 채택한 데에서 비롯된 것이다.

기존 챗봇보다 추론 능력이 뛰어나며, 수학 및 코딩 작업에서 특히 강점을 보인다.

'오픈AI o1'은 코드명 '스트로베리'로 개발된 AI 모델로, 단계적 사고 과정을 통해 어려운 문제를 해결한다.

'o1' 모델은 학습된 데이터와 추론 능력을 대학 박사 과정 수준으로 끌어올렸으며, 일반적인 채팅보다는 심도 있는 질문에 대해 더 핵심적이고 정리된 답변을 제공한다.

특히 코딩 분야에서 뛰어난 성능을 보여 개발자들로부터 높은 평가를 받고 있다.

오픈AI 수석 과학자 야쿱 파초키는 이 모델이 기존 모델보다 답변 시간이 길지만, 더 나은 해답을 제시한다고 언급했다.

이는 코딩뿐만 아니라 수학, 과학 연구 등 다양한 분야에서 활용될 수 있는 가능성을 열어준다.

실제로 'o1'은 국제수학올림피아드 예선에서 이전 모델보다 훨씬 높은 정답률을 기록했다.

오픈AI는 'o1'이 복잡한 수학 공식 작성이나 의료 연구 지원에 유용하다고 강조하며, 이해하기 힘든 한국어 문장을 영어로 정확하게 번역하는 예시를 공개했다.

또한, 오픈AI는 '생각의 사슬(CoT)' 기법을 사용해 프롬프트 엔지니어링의 필요성을 줄였으며, 이를 통해 AI 모델의 자동화된 문제 분석 능력을 향상시켰다.

이 모델은 챗GPT 플러스와 챗 팀즈 서비스 가입자와 기업이 이용할 수 있으며, 오픈AI는 함께 소형 모델 'o1-mini'도 공개했다.

o1 vs GPT-4o 비교 표

| 모델 | o1-preview | o1-mini | GPT-4o | GPT-4o mini |

| 출시일 | 2024.09.12 | 2024.09.12 | 2024.05.13 | 2024.07.18 |

| 입력 컨텍스트 창 토큰 수 | 128K | 128K | 128K | 128K |

| 최대 출력 토큰 수 | 32.8K | 65.5K | 2,048 | 16.4K |

| 지식 단절 시기 | 2023.10 | 2023.10 | 2023.10 | 2023.10 |

| TTFT* | 12.763초 | 5.383 초 | 0.421초 | 0.345초 |

| 특징 | - 간결하고 명확하게 프롬프트 작성 - 추론 시간 느림 |

- 상세한 지시와 단계별 설명을 포함하여 프롬프트 작성 - 추론 시간 빠름 |

||

| 용도 | - 복잡하고 광범위한 지식이 필요한 태스크에 이상적 (코딩, 수학, 과학 분야에 최적화) | - 다목적 고성능으로 일반적인 태스크 또는 비전 기능이 필요한 태스크에 적합 | ||

*TTFT: Time to First Token, 처음 토큰 생성까지의 시간

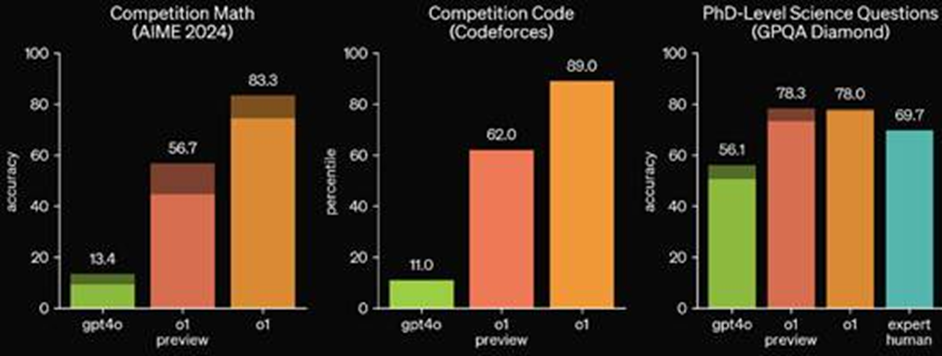

o1 vs GPT-4o 성능 비교 (수학, 코드, 과학 질문 벤치마크 데이터셋 기준)

o1은 어려운 추론 벤치마크에서 gpt-4o에 비해 크게 향상됨. 실선 막대는 pass@1 정확도를 나타내고, 음영 처리된 부분은 64개의 샘플로 다수결 투표를 사용한 성능을 보여줌.

o1 vs GPT-4o 가격 비교

| 모델 | 입력 토큰 | 출력 토큰 |

| o1-preview | $15.00 / 1M | $60.00 / 1M |

| o1-mini | $3.00 / 1M | $12.00 / 1M |

| GPT-4o | $5.00 / 1M | $15.00 / 1M |

| GPT-4o mini | $0.150 / 1M | $0.600 / 1M |

2. Implication: 오픈AI의 새로운 모델 'o1'의 출시로 챗봇 이용료가 상승할 전망이다.

사용자는 검색용은 GPT-4o를, 숙제나 보고서 작성용은 o1을 사용하는 식으로 용도에 맞춰 모델을 선택해야 한다.

특히, 오픈AI는 프론티어 모델 경쟁에서 우위를 점하고 있으며 향후 'GPT-5' 모델의 출시 가능성도 주목받고 있다.

3. 참고 기사: https://openai.com/o1/

https://www.etnews.com/20240913000096

https://www.aitimes.com/news/articleView.html?idxno=163400

메타, 첫 멀티모달모델 '라마 3.2' 출시..."오픈 소스로 폐쇄형 잡을 것"

1. Summary: 메타가 '라마' 시리즈 중 이미지와 텍스트를 모두 이해하는 첫번째 대형멀티모달모델(LMM)을 출시했다.

오픈소스로 공개되어 OpenAI나 Anthropic의 폐쇄형 모델과 경쟁할 것으로 예상된다.

11B와 90B 파라미터의 소형 및 중형 모델, 온디바이스 AI용 1B 및 3B 텍스트 전용 모델이 출시되었으며, 12만8000 토큰의 컨텍스트 길이를 지원한다.

메타는 이날 처음으로 공식 '라마 스택 배포판'을 공유, 개발자가 온프레미스와 디바이스, 클라우드, 단일 노드 등 다양한 환경에서 모델을 사용할 수 있도록 했다.

마크 저커버그 CEO는 오픈소스 AI를 "AI의 리눅스"라고 표현하며 그 중요성을 강조했다.

라마 3.2는 이미지 인식 및 시각적 이해 작업에서 Anthropic의 Claude 3 Haiku와 OpenAI의 GPT-4와 경쟁할 수 있다고 주장한다.

모델은 메타 홈페이지, Hugging Face, 그리고 메타의 파트너 플랫폼에서 다운로드할 수 있다.

2. Implication: 라마 3.2가 텍스트와 이미지를 모두 이해할 수 있는 첫 번째 오픈소스 대형멀티모달모델이라는 점은 AI 기술이 더욱 복합적이고 다양한 형태의 데이터를 처리할 수 있게 되었음을 의미한다.

저커버그가 이를 "AI의 리눅스"라고 표현한 것은 오픈소스 AI가 산업 표준이 될 수 있는 잠재력을 강조한 것이다.

3. 참고 기사: https://www.aitimes.com/news/articleView.html?idxno=163700

KAIST, 엔비디아 GPU 없이 AI 학습하는 프레임워크 개발

1. Summary: KAIST 한동수 교수 연구팀이 일반 소비자용 GPU를 활용해 네트워크 대역폭이 제한된 분산 환경에서 AI 모델 학습을 수십에서 수백배 가속할 수 있는 기술을 개발했다.

기존 AI 모델을 학습하기 위해서는 고성능 서버용 GPU(Ex-H100) 여러대와 이를 연결하기 위한 400Gbps급 네트워크를 가진 인프라가 필요했다.

하지만 거대 IT 기업을 제외한 대부분의 기업과 연구자들은 비용 문제로 이러한 인프라를 도입하긴 어려웠다.

연구진은 ‘StellaTrain’ 이라는 분산 학습 프레임워크를 개발했고, 일반적인 인터넷 환경에서도 효율적인 분산 학습을 가능하게 했다.

이는 네트워크 속도에 맞게 데이터를 효율적으로 압축 및 전송하는 알고리즘을 활용한다. 또한 학습 작업을 단계적으로 나누어 CPU와 GPU가 병렬로 처리할 수 있도록 파이프라인을 구성했다.

이를 사용할 경우 기존 대비 최대 104배 빠른 성능을 낼 수 있는 것으로 나타났다.

2. Implication: AI 모델 학습에는 일반적으로 고사양의 GPU 서버와 인프라가 필요했다.

이로 인해 많은 연구자와 기업이 고성능 장비를 갖추지 못해 연구에 제약을 받곤 했다.

그러나 최근, 위와 같이 저성능 장비로도 대규모 AI 모델을 학습할 수 있는 기술들이 발전하고 있다.

이러한 기술들은 분산 학습과 모델 압축 등을 통해 작은 규모의 장비에서도 가능성을 열었다.

이로 인해 개인 연구자와 소규모 기업이 더 많은 기회를 갖게 될 것으로 기대된다.

3. 참고 기사: https://www.aitimes.com/news/articleView.html?idxno=163492

https://github.com/kaist-ina/stellatrain

구글, 통계 데이터 응답 정확도 높인 모델 ‘데이터젬마’ 공개

1. Summary: 논리나 산술, 비교 연산 등이 수반되는 통계 데이터 쿼리에 대한 응답 정확도를 높이는 모델이 나왔다.

이를 통해 수치 및 통계적 사실과 관련된 모델의 환각 문제를 해결할 수 있게 됐다.

대형언어모델(LLM)은 수치나 통계 데이터 등을 포함하는 질문에 대해 부정확한 정보를 생성하는 경향이 있다.

통계적 사실과 관련된 사용자 쿼리에는 다양한 논리, 산술 또는 비교 연산이 포함될 수 있기 때문이다.

또, 공개된 통계 데이터에는 올바르게 해석하려면 종종 배경에 대한 맥락을 파악할 필요가 있다.

구글은 공공 통계 저장소인 데이터 커먼스(Data Commons)의 실세계 데이터를 활용해 두가지 접근 방식으로 젬마 모델을 미세 조정했다.

첫번째 방식인 RIG(Retrieval Interleaved Generation)은 모델의 원래 생성 결과와 데이터 커먼스에 저장된 관련 통계를 비교하는 방식이다.

두번째 접근 방식은 이미 훈련 데이터 외의 정보를 통합하기 위한 RAG 기법이다.

101개의 수작업 쿼리 세트를 사용한 테스트 결과, RIG로 미세 조정된 데이터젬마 변형 모델은 기존 모델의 정답율을 5~17%에서 58%로 향상시킬 수 있었으며, RAG의 경우 24~29%의 쿼리에 대해 통계적 응답을 제공할 수 있었다.

이처럼, RIG와 RAG 모두 통계 쿼리를 처리하는 모델 정확성을 향상하는데 효과적일 수 있다는 것을 입증했다.

2. Implication: 그간 모델들의 수리 연산에서 환각 증상이 생겨 직접적인 업무 적용에 어렵다는 의견이 있었다.

이를 보완하는 방법으로 구글에서 데이터젬마라는 변형 모델을 내놓은 것으로 보인다.

다양한 방법으로 수리 연산에서의 문제점을 해결하려고 했으나, 아직까지는 반절 정도만 맞추는 것으로 확인할 수 있어, 업무에 직접적으로 적용해 사용하는 것은 어려울 것으로 보인다.

최근 공개된 오픈AI의 o1 모델 또한 수리 연산에 최적화되어 있지만, 긴 연산 시간과 GPT-4o의 4배에 가까운 비용으로 인해 아직까지는 기업에서 직접적으로 업무에 적용할 만한 LLM 모델은 없는 것으로 판단된다.

3. 참고 기사: https://www.aitimes.com/news/articleView.html?idxno=163406

오픈AI, '챗GPT' 구독료 올린다..."내년 매출은 올해 3배 예상"

1. Summary: 오픈AI가 올해 안으로 '챗GPT'의 월 사용료를 현재 20달러에서 22달러로 인상할 계획으로 알려졌다.

이는 막대한 비용을 메우기 위한 것으로, 올해 적자가 50억달러(약 6조6000억원)에 달할 것이라는 예측이다.

대신, 내년에는 올해보다 매출이 3배로 증가, 116억달러(약 15조2000억원)를 기록할 것으로 기대했다.

이에 따르면 챗GPT 유료 사용자는 1000만명에 달하기 때문에, 이번 월 2000만달러(약 260억원)의 추가 수익이 생길 수 있으며, 앞으로 5년 동안 지속적으로 가격을 인상, 2029년에는 월 44달러(약 5만8000원)까지 올릴 계획이다.

하지만, 사용자 반발이 심할 것으로 예측했다.

자체 설문 조사에 따르면, 많은 사용자가 현재의 20달러도 너무 비싸다고 생각한다고 답했다.

오픈AI는 지난 5월 'GPT-4o'를 출시한 이후 가파른 매출 상승세를 그리고 있는데, 내년에는 'GPT-5'나 '서치GPT' 등을 기반으로 한 AI 음성 비서 기능의 수요가 크게 늘어116억달러로 매출이 크게 증가할 것으로 추정된다.

2. Implication: AI 기술의 발전은 막대한 연구개발 비용과 인프라 투자를 필요로 하며, 이는 결국 서비스 가격 인상으로 이어질 수밖에 없다.

오픈AI의 사례에서 볼 수 있듯이, AI 기업들은 초기에 막대한 적자를 감수하면서도 기술 개발과 시장 점유에 집중하고 있다.

다만 사용자들이 현재 가격도 비싸다고 느끼는 상황에서의 가격 인상 계획은 사용자 이탈 위험을 내포한다.

AI 기업들은 서비스의 가치를 높이면서도 사용자들이 수용할 수 있는 가격 정책을 수립해야 하는 과제를 안고 갈 것으로 보인다.

3. 참고 기사: https://www.aitimes.com/news/articleView.html?idxno=163786

오늘은 9월에 핫했던 AI 관련 이슈들을 정리해봤는데요!

코딩부터 수학, 과학, 통계까지 이젠 AI가 못하는 것이 없을 정도인데요.

AI의 도움을 받아 각 분야에서 더 다양하고 활발한 연구가 이루어질 수 있길 바라봅니다.

그럼 여기서 마무리하고, 다음달에도 더 유용한 AI 정보들로 찾아오겠습니다!